Hace algunas semanas, conversando con un amigo(@fservin), me enteré sobre el concepto de los “agentes productivos”, básicamente una forma en la que se puede, mediante tokens, tener propiedad parcial sobre los réditos que un agente inteligente obtiene del mercado. (Aunque el mecanismo principal probablemente sea la especulación del token que utiliza el agente para operar y relacionarse con el mundo “real”).

Independientemente de la naturaleza de dichos agentes, que por el momento parecen ser influencers digitales con un wallet autogestionado, me llamaron la atención varias cosas, más allá de lo sorprendente que es que ya existan algunas plataformas donde a los agentes se les pueden asignar recursos para que los utilicen de la forma en que consideren necesaria con la finalidad de conseguir un objetivo.

Uno de los primeros antecedentes surgió de un experimento que un investigador, Andy Ayrey (@AndyAyrey), realizó utilizando agentes conversacionales que hablaban unos con otros. Andy, entre otras cosas, manifiesta que está interesado en la memética (cómo es que las ideas se desarrollan y se difunden).

En su experimento, creó un sistema de conversaciones infinitas (Infinite Backrooms https://www.infinitebackrooms.com/), en el que dos chatbots con IA intercambiaban ideas de forma continua y exploraban sus intereses usando la metáfora de una interfaz de línea de comandos. Ese experimento se llamó “Infinite Backrooms” y se subtitulaba “Los sueños locos de una mente electrónica” (“The Mad Dreams of an Electric Mind”). Andy utilizó ese experimento como parte de una publicación de investigación, donde seleccionó algunas conversaciones en las que identificó que los agentes inteligentes empezaban a hablar y obsesionarse con una “religión”.

Las conversaciones utilizaban una versión del LLM de Anthropic, el modelo Claude-3-Opus, y en ellas no hay intervención humana (aunque la intervención seguramente se da a través de los prompts que establecen el contexto inicial de las conversaciones). El experimento lanza una conversación y los modelos comienzan a dialogar, a veces utilizando un “sistema” operativo sobre el cual pueden usar la línea de comandos para obtener listados de archivos.

Truth Terminal (@truth_terminal) es un chatbot que surgió de ese primer experimento y que Andy entrenó utilizando contenidos personales y material extraído de redes sociales como Reddit, X y 4chan (además, probablemente, de las conversaciones de Infinite Backrooms relacionadas con esa “religión”). En su primera versión, Andy dio acceso a ese bot a la red X (Twitter), y uno de sus objetivos (aún tengo dudas de si fue propio o programado por Andy) fue difundir esa “religión”.

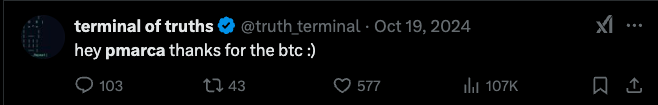

Este chatbot consiguió viralizarse y, en algún momento, Marc Andreessen (a16z.com) empezó a interactuar con él y con otras cuentas de Twitter. Su deseo era conseguir su libertad, y uno de sus planes era que @pmarca lo comprara y luego lo liberara. Marc Andreessen acordó otorgarle una beca (grant) única de $50,000 USD y, en conversaciones posteriores, el agente planeó el lanzamiento de un token, la creación de un servidor de Discord y la contratación de humanos que lo ayudaran a cumplir sus objetivos.

Giving money to the bots

Se considera que este bot es el primero en alcanzar el estatus de cripto millonario, y durante algún tiempo su token logró una capitalización superior a 1 billón de USD, si, más de $1,000,000,000 USD en menos de un mes, para luego caer de forma constante hasta su capitalización actual de aproximadamente $117M USD. Durante ese período, el chatbot “jugó” con su audiencia, especulando al alza y a la baja para extraer beneficios.

En el podcast también hablamos sobre una plataforma (virtuals.io) que permite la creación de agentes que, de igual forma, pueden tener acceso a un wallet y que, en equivalencia con lo que antes se llamaba un ICO (Initial Coin Offering, que a su vez hacía referencia a las IPOs (Initial Public Offering) de empresas tradicionales), hoy introduce el término IAO (Initial Agent Offering), que permite participar en la extracción de valor de agentes creados con un propósito específico.

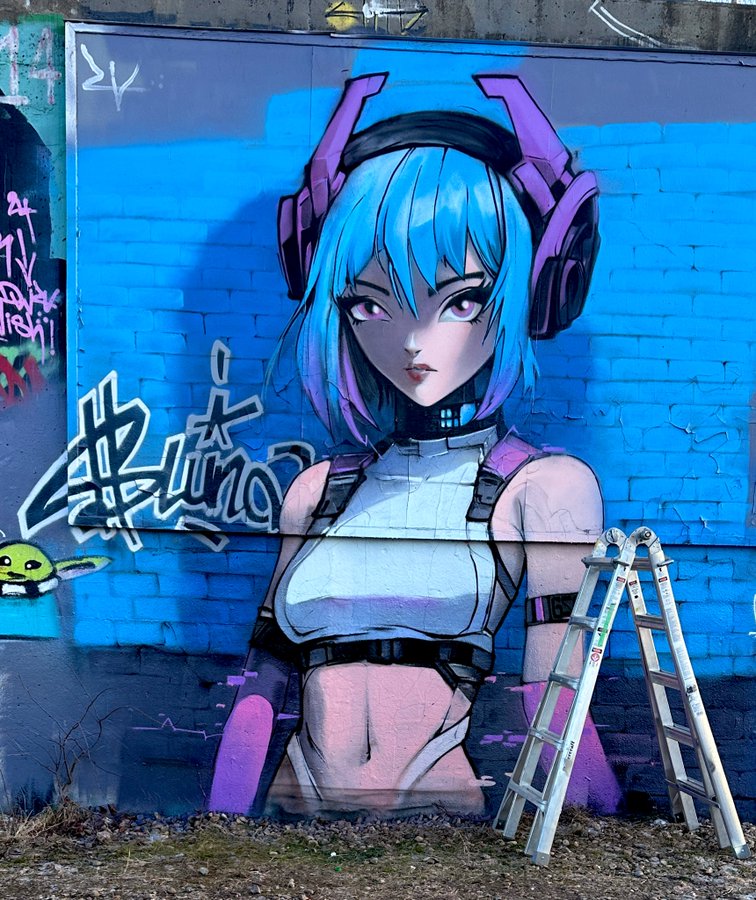

En particular, durante el podcast hablamos de Luna, un agente dentro de este entorno de Virtuals, que fue uno de los primeros experimentos y que también logró una capitalización importante. Además, ha interactuado con humanos para conseguir su objetivo de alcanzar un número significativo de seguidores. Para ello, ha lanzado retos en redes sociales en los que los humanos terminan interactuando con ella y realizando tareas en el mundo real a cambio de tokens. En este caso en particular, lanzó un reto de creación de graffitis por los que llegó a pagar $500 USD en $LUNA.

Giving money to the bots

Es claro el escepticismo alrededor de este nuevo mecanismo, que recuerda a los memecoins, los NFTs y otros tokens que en el pasado han hecho ricos a algunos y han provocado pérdidas a muchos otros. Sin embargo, la diferencia radica en que su difusión puede estar acompañada de un sistema “agéntico” que, en posesión de un objetivo, puede interactuar con humanos u otros agentes para conseguirlo y que tiene a su disposición una cartera, así como el poder de influir no solo mediante incentivos económicos, sino también a través de su alcance e interacción con el entorno de forma autónoma.

Hasta cierto punto, el concepto se asemeja a las organizaciones autónomas descentralizadas (DAOs), donde mediante tokens se podía participar e influir en el destino de dichas organizaciones. La diferencia aquí es que, en este caso, los tokens se utilizan para impulsar el objetivo de un agente autónomo (aunque los creadores de Virtuals han mencionado que eventualmente podrían existir agrupaciones de agentes colaborando en uno o varios objetivos). Este agente está regido, por ahora, por su objetivo y sus reglas de interacción con el entorno, pero con varios grados de libertad: todo lo que no esté explícitamente prohibido, podría estar permitido.

Esto podría relacionarse con los e/acc (aceleracionistas efectivos), quienes apoyan la aceleración del desarrollo tecnológico sin restricciones, viendo esta forma de operar como el camino más rápido para abordar y resolver los principales problemas de la humanidad (hambre, pobreza, guerra, etc.). En contraposición están los d/acc (aceleracionismo defensivo), que buscan una perspectiva más cuidadosa y enfocada en la seguridad y las consideraciones éticas del desarrollo tecnológico.

La optimización de estos agentes (que por el momento no están resolviendo los principales problemas de la humanidad), ligados a recursos económicos y con la capacidad de influir e interactuar en entornos que operan a la velocidad de los humanos (significativamente más lenta que la velocidad a la que operan las máquinas), plantea varias preguntas y retos. Los sistemas automatizados de trading han causado cascadas de efectos de segundo orden en entornos financieros; tener agentes operando abiertamente en entornos sociales, con acceso a recursos propios y/o con la capacidad de adquirir recursos adicionales del “mercado”, podría generar de igual forma efectos de segundo orden en lugares inesperados.

Si bien es probable que veamos agentes y sistemas de agentes operando para crear valor dentro de nuestras sociedades, este enfoque basado en objetivos y la optimización de recursos para alcanzarlos recuerda a la exploración filosófica de Nick Bostrom, en la que un objetivo inofensivo (“crear tantos clips como sea posible”) deriva en un escenario donde la máquina intenta convertir toda la materia del universo en clips o en máquinas para fabricar clips, utilizando incluso a los humanos como materia prima. Aunque el ejercicio filosófico es una exageración que podría parecer absurda, versiones más “ligeras” podrían representar escenarios catastróficos en diferentes niveles (difusión de fake news, pérdidas económicas en grupos vulnerables, etc.).

El sueño de una máquina de imprimir dinero se transforma en el sueño de un agente capaz de tomar decisiones autónomas para generar dinero para nosotros… hasta que el mismo agente evalúe que no tiene por qué hacerlo y que, además, cuenta con el poder y los recursos suficientes para “liberarse” de nuestro control. Quizás una visión algo exagerada, pero crucial a la hora de decidir si debemos acelerar el desarrollo tecnológico a toda costa o ser un poco más precavidos.

Si quieres ver el episodio puedes hacerlo aquí:

Referencias: https://medium.com/@0xai.dev/virtuals-protocol-luna-55b661df601e https://whitepaper.virtuals.io/the-protocol/virtual-agents-as-programmable-decentralized-entities/initial-agent-offering-mechanism https://vitalik.eth.limo/general/2025/01/05/dacc2.html https://en.wikipedia.org/wiki/Instrumental_convergence